DeepSeek-V4,真的来了!

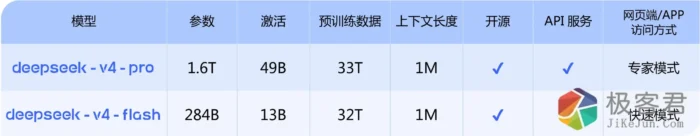

全名 DeepSeek-V4 预览版,两个型号,DeepSeek-V4-Pro 和 DeepSeek-V4-Flash。

一起开源。都支持 1M 上下文。

DeepSeek 官方的原话。

「使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式,但仍与 Opus 4.6 思考模式存在一定差距。」

V4-Pro:1.6T 总参数,49B 激活,33T 预训练数据。

V4-Flash:284B 总参数,13B 激活,32T 预训练数据。

1M 上下文。

![5f0e8dfa8b20260424191155 图片[1]-DeepSeek-V4 正式上线,支持 1M 上下文-极客君](https://www.jikejun.com/wp-content/uploads/2026/04/5f0e8dfa8b20260424191155.webp)

1.6T 的模型,直接在 Hugging Face 开源。DeepSeek,还是那个我们熟悉的 DeepSeek。

Agentic Coding 是 V4-Pro 这次主打的能力。

Terminal Bench 2.0,V4-Pro 67.9 分,Claude Opus 4.6 Max 65.4,GPT-5.4 xHigh 75.1。

SWE Verified,V4-Pro 80.6,和 Opus 4.6 Max 的 80.8 差 0.2 分。

Codeforces 评分 3206,超过 GPT-5.4 xHigh 的 3168 和 Gemini-3.1-Pro-High 的 3052。

![b93182b23b20260424191158 图片[2]-DeepSeek-V4 正式上线,支持 1M 上下文-极客君](https://www.jikejun.com/wp-content/uploads/2026/04/b93182b23b20260424191158-scaled.webp)

SimpleQA Verified 这一项,V4-Pro 57.9,Opus 4.6 Max 46.2,GPT-5.4 xHigh 45.3。只输给 Gemini-3.1-Pro-High 的 75.6。

「大幅领先其他开源模型,仅稍逊于顶尖闭源模型 Gemini-Pro-3.1。」

这是更全的基准测试对比图。

![e58a3c8e3e20260424191201 图片[3]-DeepSeek-V4 正式上线,支持 1M 上下文-极客君](https://www.jikejun.com/wp-content/uploads/2026/04/e58a3c8e3e20260424191201.webp)

百万上下文这次靠的是一套新结构。

DeepSeek-V4 用了一种全新的注意力机制,在 token 维度做压缩,配合 DSA 稀疏注意力(DeepSeek Sparse Attention)。

对比 V3.2,每个 token 的计算量和显存都降下来了。

从今天起,1M 上下文是 DeepSeek 所有官方服务的标配。

百万 token,1 块钱起。

V4-Pro:缓存命中 1 元,缓存未命中 12 元,输出 24 元(每百万 token)。

V4-Flash:缓存命中 0.2 元,缓存未命中 1 元,输出 2 元。

Flash 版本,百万 token 跑一轮任务,也就是 1 到 2 块。

![7c7512331120260424191202 图片[4]-DeepSeek-V4 正式上线,支持 1M 上下文-极客君](https://www.jikejun.com/wp-content/uploads/2026/04/7c7512331120260424191202.webp)

「受限于高端算力,目前 Pro 服务吞吐十分有限。预计下半年昇腾 950 超节点批量上市之后,Pro 的价格还会大幅下调。」

Agent 侧做了专门适配。

DeepSeek-V4 针对 Claude Code、OpenClaw、OpenCode、CodeBuddy 等主流 Agent 产品都做了优化。

DeepSeek 说,V4-Pro 已经是公司内部员工自己用的 Agentic Coding 模型。

据内部评测反馈,使用体验优于 Sonnet 4.5,交付质量接近 Opus 4.6 非思考模式。但和 Opus 4.6 思考模式还有一定差距。

旧接口 deepseek-chat 和 deepseek-reasoner,三个月后(2026-07-24)停用。

当前这两个名字分别指向 V4-Flash 的非思考模式和思考模式。

用新模型直接改 model_name 为 deepseek-v4-pro 或 deepseek-v4-flash。base_url 不变。

DeepSeek 这篇官方推送的结尾引用了一句话。

「不诱于誉,不恐于诽,率道而行,端然正己。」

源神回来了。