昨天音乐,今天语音。

刚刚,谷歌发布 Gemini 3.1 Flash Live,专为实时对话打造的语音模型。

它能听、能看,还能原地调用工具。

谷歌今天还把 Search Live 推到了全球 200 多个国家。

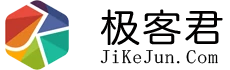

ComplexFuncBench Audio 测试 AI 语音模型在聊天时能不能完成多步工具调用。

比如你说「帮我查明天最早去上海的飞机,然后加到日历」,它能不能边聊边搜索、筛选、写入日历。

谷歌上一代实时语音模型 2.5 Flash Native Audio,当时 ComplexFuncBench Audio 的成绩是 71.5%。

Gemini 3.1 Flash Live 断层提升,90.8%。

谷歌 AI Studio 负责人 Logan Kilpatrick 说,「我们花了一年多,模型、基础设施、用户体验全部推倒重做。」

Gemini 3.1 Flash Live 加了一层背景音过滤。

以前你在马路边、电视响着的环境里,模型分不清噪音和人声,很可能就把电视里的人声当成你的指令。现在能分清了。

也更听话了。你给它一套系统提示词,让它当客服只聊产品问题。以前可能聊着聊着就跑偏了,现在即使话锋一转,它也能遵循原有指令。

响应更快。对话里的尴尬停顿明显减少。

而且支持 90 多种语言。

Search Live 是今天最重磅的发布之一。

这个功能从 2025 年 7 月上线到现在,一直只在美国和印度能用。今天谷歌一口气推送到全球 200 多个国家和地区。

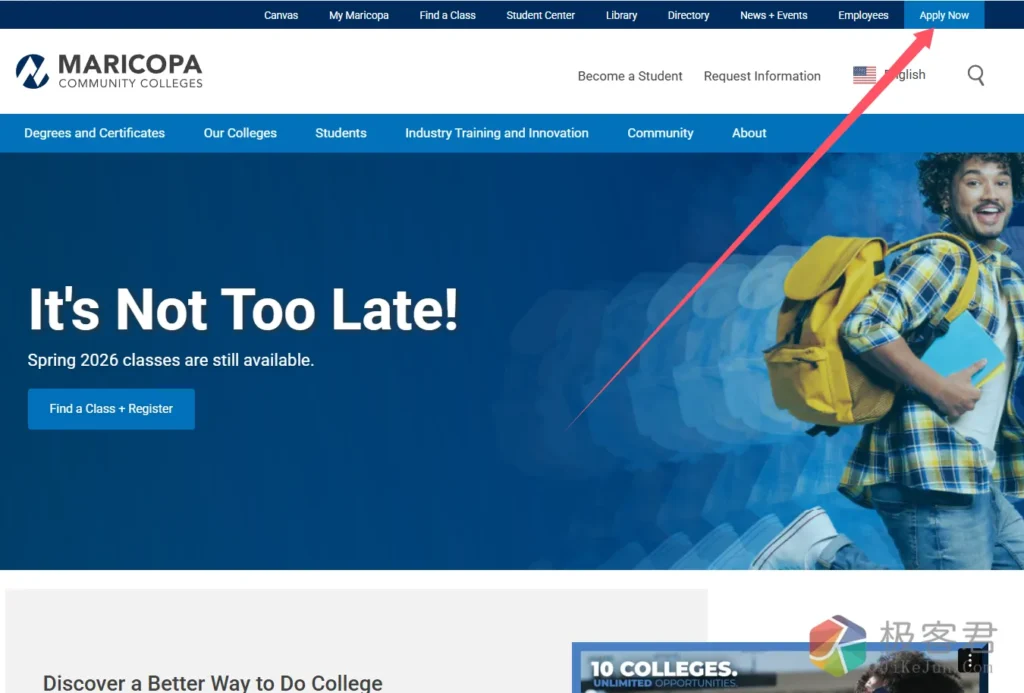

打开谷歌 App,搜索栏下面有个 Live 图标。

点进去,直接和谷歌搜索对话。问完一个问题,它用语音回答你,你可以继续追问,就像打电话一样。

还能打开摄像头。对着一个东西问「这是什么」,它能看到你的画面,实时回答。

Google Translate 的「耳机同声传译」也终于登陆你的 iPhone。

我们之前聊过这个功能,当时只有安卓能用。那篇文章结尾我写道,「iOS 和更多地区要等明年了。」

现在,它来了。

除了 iOS 上线,「同声传译」还扩展到了法国、德国、意大利、日本、西班牙、泰国和英国。

打开 Google Translate,选择 Live translate。你的耳机直接变身为支持 70 多种语言的实时翻译。

打开 Gemini App,Gemini Live 已经换上了刚刚发布的 3.1 Flash Live。

响应更快,尴尬停顿更少,能记住的对话长度翻倍了。

以前聊几轮可能就忘了之前说过什么,现在能记住更长的上下文。

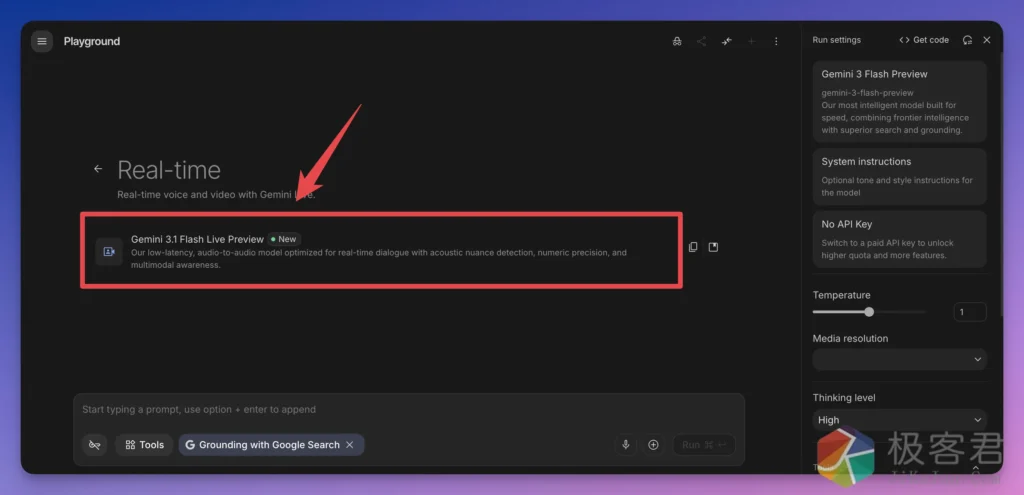

AI Studio 也已经全面支持 Gemini 3.1 Flash Live,模型 ID gemini-3.1-flash-live-preview。

打开 AI Studio。默认 Playground,选 Real-time 模式,开聊。

划重点,免费。

实时语音赛道,OpenAI 有 Realtime API。谷歌是 Gemini Live API。

Anthropic 到今天都没有语音模型。Claude 死磕推理和编程,语音不是优先级。

OpenAI 在打断控制上稍微领先。你打断 AI 说话的时候,它停得更干脆,马上让你接话。

谷歌更大的优势在多模态和多语言。90 种语言,加上视觉输入,搜索、地图、翻译整套自家生态都能调用。

小细节,所有 Gemini 3.1 Flash Live 生成的音频都带 SynthID 水印。你听不出来,但机器能检测到,防深度伪造。

谷歌这周杀疯了。

昨天发布 Lyria 3 Pro,AI 音乐从 30 秒升级到 3 分钟。

今天上线 Gemini 3.1 Flash Live,Search Live 推送到 200 国,耳机实时翻译登陆 iOS。

两天。四个产品。