最近 AI 视频圈可以说是被一个名字刷屏了 —— LTX-2。它不仅完全免费开源,而且直接把现在最前沿的视频生成能力,一股脑塞进了一个模型里。LTX-2 是第一个基于 DiT 的音视频基础模型,它将现代视频生成的所有核心功能集成在一个模型中:同步音频和视频、高保真度、多种性能模式、可用于生产的输出、API 访问和开放访问!

更离谱的是:8GB 显存的家用显卡就能跑本地生成,不用排队、不用云端、不怕限速想生成多少就生成多少!可以说,这是第一次,普通人真正有了“自己的视频生成工厂”。关键是它可以生成那种 “老司机” 秒懂的AI视频,本地生成没有任何限制……

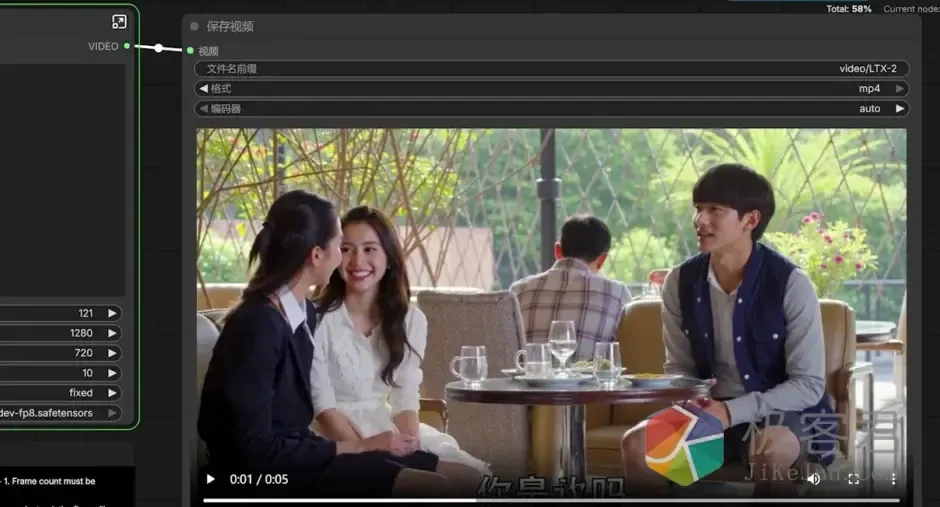

对中文的提示词理解也超准确,生成的人物也非常适合我们亚洲人的审美标准,比如下方的生成效果,无论是男孩还是女孩,颜值确实很高!

LTX-2 开源项目:https://github.com/Lightricks/LTX-2

快速部署:

# Clone the repository

git clone https://github.com/Lightricks/LTX-2.git

cd LTX-2

# Set up the environment

uv sync --frozen

source .venv/bin/activate所需模型

从LTX-2 HuggingFace 存储库下载以下模型:

LTX-2 型号检查点(选择并下载以下其中一项)

空间放大器– 此存储库中当前两阶段流水线实现所必需的

时间放大器– 该模型支持此功能,并且是未来管道实现所必需的。

精简版 LoRA – 此存储库中当前两阶段流水线实现所必需的(DistilledPipeline 和 ICLoraPipeline 除外)

Gemma文本编码器(从存储库下载所有资源)

LoRA

LTX-2-19b-IC-LoRA-Canny-Control–下载LTX-2-19b-IC-LoRA-Depth-Control–下载LTX-2-19b-IC-LoRA-Detailer–下载LTX-2-19b-IC-LoRA-Pose-Control–下载LTX-2-19b-LoRA-Camera-Control-Dolly-In–下载LTX-2-19b-LoRA-Camera-Control-Dolly-Left–下载LTX-2-19b-LoRA-Camera-Control-Dolly-Out–下载LTX-2-19b-LoRA-Camera-Control-Dolly-Right–下载LTX-2-19b-LoRA-Camera-Control-Jib-Down–下载LTX-2-19b-LoRA-Camera-Control-Jib-Up–下载LTX-2-19b-LoRA-Camera-Control-Static–下载

可用管道

- TI2VidTwoStagesPipeline – 生产级文本/图像转视频,支持 2 倍升频(推荐)

- TI2VidOneStagePipeline – 用于快速原型设计的单阶段生成

- DistilledPipeline – 具有 8 个预定义 sigma 的最快推理

- ICLoraPipeline – 视频到视频和图像到视频的转换

- 关键帧插值管道– 在关键帧图像之间进行插值

优化技巧

- 使用 DistilledPipeline – 仅使用 8 个预定义 sigma 即可实现最快的推理(第一阶段 8 个步骤,第二阶段 4 个步骤)

- 启用 FP8 转换器– 降低内存占用:

--enable-fp8(CLI)或fp8transformer=True(Python) - 安装注意力机制优化– 使用 xFormers (

uv sync --extra xformers) 或适用于 Hopper GPU 的Flash Attention 3 - 使用梯度估计——在保持质量的前提下,将推理步骤从 40 步减少到 20-30 步(参见流程文档)。

- 跳过内存清理– 如果您的显存足够,请禁用阶段间的自动内存清理,以加快处理速度。

- 选择单阶段流水线——适用

TI2VidOneStagePipeline于不需要高分辨率时快速生成图像的情况。

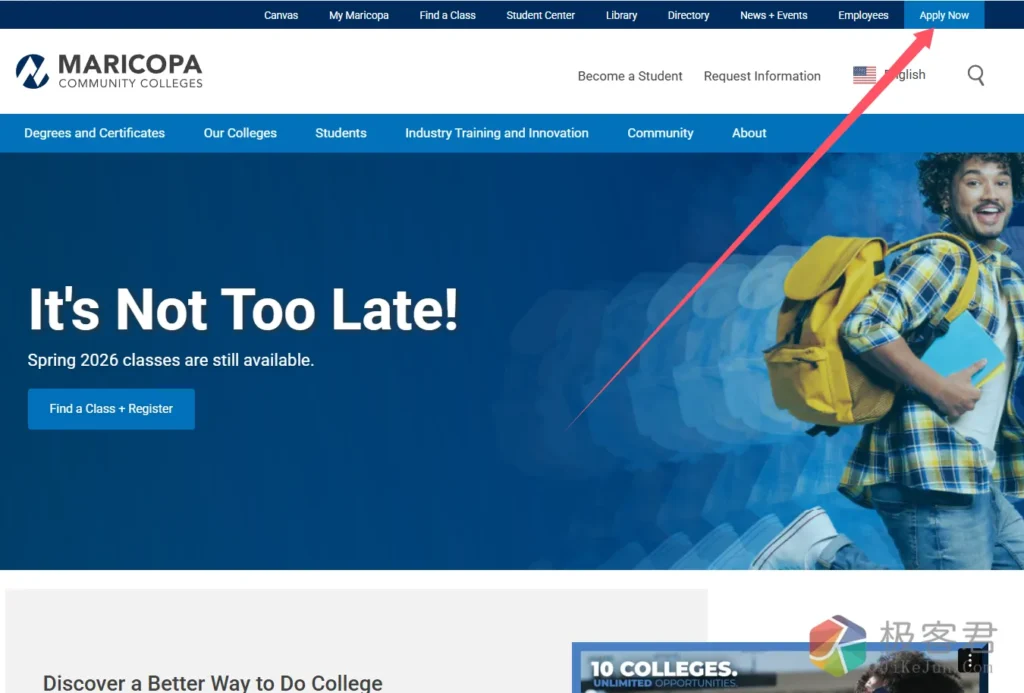

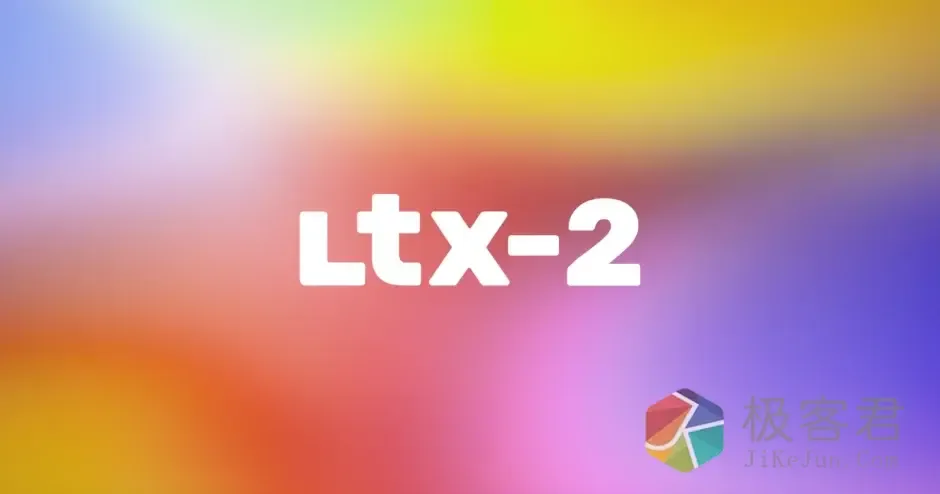

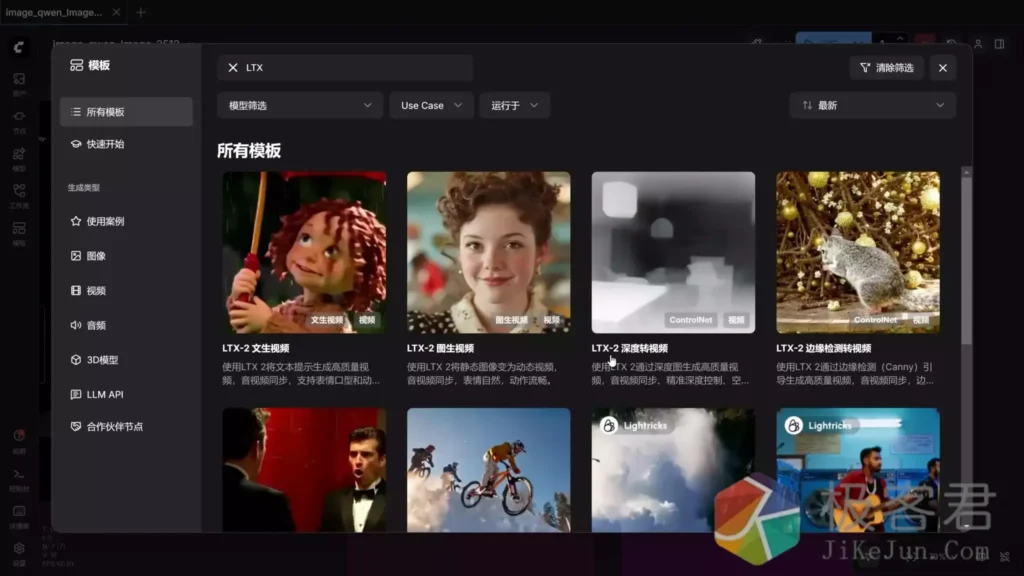

当然对于新手来说,我建议大家直接使用ComfyUI 进行一键部署,会超级方便!

ComfyUI 最新版:【点击下载】

【注意】: 由于 ComfyUI 官方客户端所必须的环境安装包和AI模型的下载是需要外网环境,如果如果你无法下载的话,那么请使用魔法,并开启TUN全局模式!

安装以后在模板中心,选择你对应的LTX-2 音视频模型,支持文生视频、图生视频、视频编辑等,如果显存比较小的,建议选择下方的量化版,这样可以避免爆显存的问题

8G 显存版模型:

1、【点击下载】 由KJ大佬提供

2、【点击下载】 适合8G一下显存

测试文生视频提示词:

1 情侣中文对话(口型+情绪测试)

用途:测试中文普通话 + 口型同步

一对 20 多岁的亚洲年轻情侣坐在咖啡馆里聊天,女生微笑着说普通话:“你还记得我们第一次见面吗?”

男生轻轻点头,用普通话回答:“当然记得,那天你穿着白色裙子,我一眼就喜欢上你了。”

自然光,真实摄影风格,镜头轻微晃动,人物口型与语音完美同步,情绪温暖真实。

2 搞笑情侣短剧

用途:测试表情变化 + 语音节奏

亚洲年轻情侣在家里吵架,女生用普通话生气地说:“你又忘记洗碗了!”

男生一脸无辜,用搞笑语气说:“我不是忘了,我是在等灵感。”

轻喜剧风格,表情夸张但自然,口型同步,节奏轻快。

3 游戏实况风格

用途:测试动态画面 + 解说同步

第一人称射击游戏画面,玩家在城市废墟中战斗,一边玩一边用普通话解说:

“这把枪后坐力太大了,但伤害真的高,我要从右边绕过去。”

画面流畅,枪声和语音同步,画面带轻微游戏 HUD。

4 主播带货风格

用途:测试真人讲解 + 口播

一位亚洲女主播面对镜头,用普通话热情介绍一款智能手表:

“这款手表不仅能测心率,还能监测睡眠,非常适合上班族。”

电商直播风格,灯光明亮,口型精准。

5 搞笑新闻播报

用途:测试长句 + 稳定语音

一位男主播用普通话严肃播报:

“今天的头条新闻是一只猫成功打开了冰箱,并且吃光了所有的鱼。”

新闻演播室背景,风格一本正经但内容搞笑。

6 自然风景纪录片

用途:测试环境音 + 旁白

航拍中国山川和湖泊,清晨薄雾环绕,一位男声普通话旁白:

“这里是大自然最宁静的角落,每一缕阳光都让人感到平静。”

电影级自然纪录片风格,声音温柔清晰。

7 狮子打斗场面

用途:测试动作 + 物理 + 音效

非洲草原上,两只雄狮激烈打斗,尘土飞扬,低吼声和脚步声同步,

镜头快速切换,真实野生动物纪录片风格,动作流畅有冲击力。

8 功夫打斗场景

用途:测试人物动作+音效同步

两名亚洲功夫高手在雨夜的街道上对决,拳脚相交,雨水飞溅,

伴随呼吸声和打斗音效,电影级动作风格,慢动作穿插。

9 AI科幻对话

用途:测试多角色对话

未来科幻实验室里,一名亚洲女科学家用普通话说:

“你真的认为自己有情感吗?”

一个人形机器人用冷静的普通话回答:

“我正在学习理解人类的情绪。”

灯光冷色调,科幻电影风格。

10 搞笑动物配音

用途:测试配音贴合

一只小狗坐在沙发上,用童趣普通话配音:

“我今天很乖,所以我要多吃一点零食。”

可爱风格,口型自然贴合。

LTX-2 是什么?为什么它突然爆火?

一句话概括:

LTX-2 是第一个真正意义上的“全能型”音视频生成大模型。

它不是那种:

-

只能生成视频但没声音

-

或者画面和声音对不上

-

或者只能低分辨率

-

或者对显卡要求离谱

LTX-2 是基于最新 DiT(Diffusion Transformer)架构构建的,这是一种目前最先进的视频生成路线,它带来了几个质变级能力:

音画同步生成

不需要再后期配音,它可以直接:

-

生成画面

-

同时生成声音

-

并且嘴型、节奏说话完全同步

这在以前基本是只有商业级模型才能做到的。

高画质 + 多性能模式

LTX-2 不只有一种“画质”,它内置多种模式,比如:

-

极速模式(适合快速出草稿)

-

省显存模式(8GB 显卡也能跑)

-

高质量模式(细节拉满)

你可以根据自己显卡的能力,自由切换。

这意味着:

它不是为土豪准备的模型,而是为普通玩家准备的。

8GB 显卡也能跑,本地部署才是最大杀器

这一点,真的要单独说。

现在市面上很多 AI 视频模型,宣传得天花乱坠,但一看要求:

-

24GB 显存

-

48GB 显存

-

甚至 A100、H100

对普通人来说基本就是“看个热闹”。

而 LTX-2 的杀手级优势是:

哪怕只有 8GB 显存,你也能在自己电脑上跑它。

这意味着什么?

你可以:

-

用 RTX 3060

-

用 3050

-

用 2060

-

甚至一些低功耗卡

直接本地生成视频。

不用:

-

排队

-

等云端

-

被限速

-

被计费

-

被封号

你就是你自己的 AI 视频工厂。

完全开源 + 无限生成,这才是真正的自由

LTX-2 是 100% 开源模型。

这点对创作者来说非常重要。

因为这意味着:

-

没有生成次数限制

-

没有内容审查锁死

-

没有“商用要额外付费”

-

你生成的视频,版权在你手里

你可以:

-

做短视频

-

做动画

-

做广告

-

做故事

-

做角色对话

-

做 AI 电影

随你怎么玩。

LTX-2 为什么会被称为“视频生成的转折点”?

过去,AI 视频是这样:

-

要么画面好但没声音

-

要么有声音但对不上嘴

-

要么要天价显卡

-

要么只能在云端被限制

而 LTX-2 把这些全部打通了:

音频 + 视频 + 高质量 + 本地运行 + 低门槛

这在整个 AI 视频领域,是第一次真正意义上的“民用化”。

总之

如果你:

-

做短视频

-

做自媒体

-

做动画

-

做 YouTube

-

做 TikTok

-

或者只是想玩 AI 视频

那么 LTX-2 就是你目前能用到的性价比之王。不是云端,不是订阅制,而是:你自己的显卡 + 你自己的模型 + 无限的视频创作能力。